테슬라 자율주행 수준

매년 자율주행, 바이오, AI 등의 기술과 전략을 리서치하고, 위와 같이 leaderboard를 배포하는 것으로 잘 알려진 Navigant Reserach 라는 리서치가 있다. 위 도표를 보면, Tesla는 다른 전통 Mobility player들과 비교할 수 없을 정도로 낮은 'Challlengers' 레벨로 기록되어있다. 왜 이런 결과가 나왔을까?

자율주행 단계

자율주행 단계는 위와 같이 Level 0 ~ Level5 까지 총 6단계로 나뉜다. 상세 내용은 다음과 같다.

-

Level 0 : 인간이 차량을 완전히 통제해야 한다.

-

Level 1 : 발을 뗄 수 있다. 일시적으로 차량의 속도나 차선 위치를 자동으로 조절해 줄 수 있다. (e.g. 크루즈 컨트롤)

-

Level 2 : 손을 뗄 수 있다. 고속도로와 같은 특정 조건에서 차량의 속도와 핸들링을 자동으로 맡길 수 있다. (눈은 못 뗀다.)

-

Level 3 : 눈을 뗄 수 있다. 고속도로와 같은 특정 조건에서 눈을 뗄 수 있지만, 언제든 다시 비상으로 운전할 준비가 되어 있어야 한다.

-

Level 4 : 마음을 뗄 수 있다. 고속도로와 같은 특정조건에서 그냥 밑고 맡겨도 된다. 비상상황도 알아서 한다.

-

Level 5 : 운전자가 없어도 된다. 모든 조건에서 차가 알아서 운전한다.

자율주행 핵심기술 : LIDAR 비전과 카메라 비전

자율주행에 필요한 센서는 주로 카메라, RADAR(레이더), LIDAR(라이다) 3가지 이다.

여기서 핵심은 LIDAR인데, 차량이 주행할 때 실시간으로 360도 레이저를 쏘고, 돌아오는 시간을 계산하여 주변 사물들을 visionizing 한 것이다. 날씨, 주/야간 상관없이 사물의 깊이와 형태등을 정확하게 파악할 수 있기에, 자율주행차의 핵심 센서로 여겨진다.

카메라는 사물에 반사되는 빛을 인식하는 것이기 때문에, LIDAR가 측정하기 힘든 사물의 명암, 대비, 색조 등은 잘 인식할 수 있지만, 마찬가지로 빛이 없는 상황 (야간, 악천후, 터널 속 등)에서 사물을 인식하는 것이 쉽지 않다.

따라서, 보통의 자율주행차를 개발하고 있는 기업(Ford, Volvo, Cruise, Waymo 등)들은 아래와 같이 카메라, 라이다, 레이더를 모두 사용하여 만들고 있다. 아래 그림은 우버가 상용화 시험하고있는 차량의 현황이다.

이 회사들(Ford, Volvo, Cruise, Waymo 등)은 맨 처음 우리가 보았던 Leaderboard에서 Tesla보다는 높은 수준을 보여주고 있다. 모두 라이다를 사용하기 때문에, 기본적으로 자율주행 레벨 3이상을 구현할 수 있기 때문이다.

테슬라 Full self-driving (FSD)

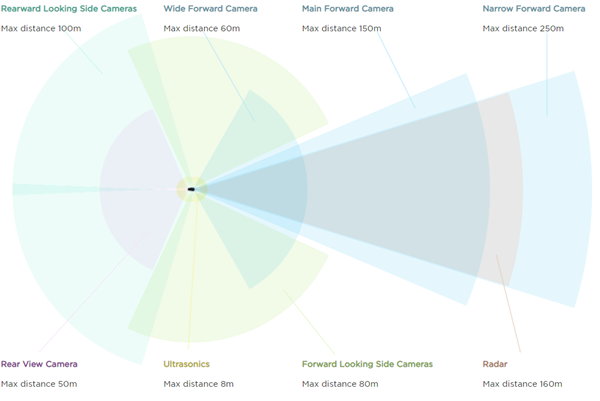

테슬라가 자율주행을 위해 탑재한 센서들은 위 그림과 같다.

-

360도 시야각 카메라 (전방, 측방, 후방, 망원)

-

Ultrasonics (초음파) 센서

-

Radar(레이더) 센서

보면, 다른 자율주행 플레이어들이 사용하는 LIDAR(라이다)를 사용하지 않고 있다.

일론머스크는 비싼 라이다 대신, 카메라비전을 AI 영상처리로 극복하겠다는 의지를 가지고 있다. 라이다는 현재 자율주행차 1대당 들어가는 가격이 $10,000정도 되기 때문에, 라이다를 탑재하여 상용화하려면 비용이 대단히 많이 들기 때문이다.

따라서, 현재 테슬라는 카메라만 가지고 Full self-driving(FSD) 옵션을 판매하고, 자율주행 first mover로서 FSD 베타테스트 영상 데이터를 수집해, 라이다를 사용하지 않은 카메라비전을 더 정교하게 개선시키겠다는 전략이다.

2020년 10월 20일 테슬라는 위와 같이 FSD (Full self-driving) beta 서비스 옵션을 시작하여 (기존 $8,000에서 $10,000로 인상), 사용자들의 주행영상을 분석하고, 이를 통해 카메라비전을 개선시키고 있다.

라이다는 여전히 사용하지 않지만, 고객들에게 오히려 돈을 받아가면서 기술을 발전시키고 있는 셈이다.

전반적인 FSD beta의 여론으로는, '괜찮다'라는 것이다. 가끔 어떤 FSD 주행영상에서 차선인식을 잘 못하는 경우가 있긴 했지만, 야간주행성능에서는 카메라비전으로 할 수 있는 최대치를 보여주고 있다는 여론이다. 실제로, 테슬라의 자율주행의 영상처리는 서로 화각이 다른 여러대의 카메라에 의존하여 사용하기 때문에 ,이미지 병합하여 영상처리의 난도가 매우 높다.

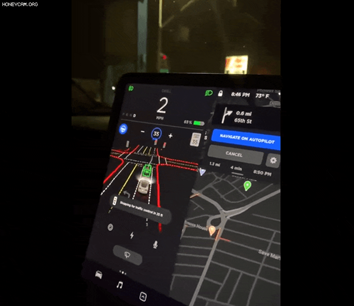

위 왼쪽 영상과 같이, 고객들에게 실시간으로 카메라비전이 인식하는 모습을 개발자화면과 같이 보여주어, 차가 스스로 주변 상황을 잘 인식되고 있는지 확인할 수 있게 한다.

테슬라 로보택시 (Robotaxi)

Tesla의 로보택시 서비스는 아주 획기적인 비즈니스 모델이다. 예를 들어, 차주들이 출근하고 주차장에 차를 놔두면, 가만히 있던 차가 혼자 무인택시 노릇을 하며 돈을 벌어온다는 비즈니스 모델이다.

그러나, 이를 할 수 있는 단계는 위 자율주행 단계에서 살펴봤듯이 '자율주행 5단계'이다. 운전자가 없이 차가 스스로 움직어야되기 때문이다.

기존의 Uber나 Lyft의 비즈니스모델인 공유차플랫폼의 마켓쉐어를, 자신들의 무인자율주행차로 뺏어오겠다는 전략이다. (Uber, Lyft도 '로보택시'와 같이 자율주행 5단계를 실현하기위해 지금도 노력하고 있다.)

문제는 일론 머스크의 구라다.

위 트윗처럼 Elon musk가 2020년안에 robotaxi가 나올 수 있다고 말을 했었다. 무려 자율주행 5단계를..

마치 트윗에 규제당국 때문에 잘 모르겠다고 하는데, 로보택시를 실현시키려면 자율주행 5단계가 필요하다. 과연 규제당국때문에 못하는 것일까?

테슬라는 자율주행 2.5단계

다시 처음으로 돌아와, Navigant Reserach에 따르면 테슬라는 자율주행 기술에서 다른 라이다를 쓰는 플레이어들과 비교하면 가장 낮은 단계의 자율주행 수준이다. 컴퓨터비전을 사용하는 Tesla의 기술은 자율주행이 아닌, ADAS(운전자보조시스템)로 초점이 맞추어져 있다고 판단 (Level 2~3) 하고 있는 것이다.

오른쪽 그림처럼, 테슬라를 타다가 손을 떼면, 손 떼지 마라고 경고문구가 나온다. 이것이 무엇을 의미하는가?

아직 테슬라는 자신들조차 자율주행 3단계가 아니라고 스스로 인정하고 있다는 것이다.

분명, FSD beta가 좋은 퍼모먼스를 보여주고 있고, 카메라 비전으로 할 수 있는 영상처리를 끝판왕을 보여주고 있지만, 아직은 자율주행 3단계가 아니다. 그럼에도 불구하고, 서비스 이름을 'FSD(Full self-driving, 완전자율주행)'로 판매하는 것 보면 moral hazard라고 생각하지 않을 수 없다.

'주식 투자 > 주식분석' 카테고리의 다른 글

| 앞으로 10년 성장할 주식 (2) - 우버(Uber) (0) | 2021.02.22 |

|---|---|

| 폭주하는 테슬라 (TSLA), 거품은 어디까지일까 (1) - 재무 분석 (2) | 2021.01.09 |

| 앞으로 10년 성장할 주식 (1) - 인모드(Inmode) (0) | 2021.01.01 |

| Commodity indices(상품선물지수) vs Natural Resources Equity (원자재주식) (4) | 2020.07.02 |

댓글